Tài liệu bí mật: Facebook dường như đặt các tính năng, lợi nhuận lên trên sự an toàn của người dùng

Facebook, người khổng lồ 13 tuổi với 1,23 tỷ người dùng đang hoạt động, tạo ra doanh thu hơn 8 tỷ USD mỗi quý - 3 tỷ USD trong số đó là thu nhập ròng (ví dụ: lợi nhuận).

Nhưng với rất nhiều người dùng, Facebook dường như đã coi sự an toàn của người dùng thành mối quan tâm thứ yếu. Cho đến đầu năm nay, Facebook chỉ tuyển dụng 4.500 người để đánh giá nội dung. Có vẻ như rất nhiều người cho đến khi bạn nhận ra rằng 1,23 tỷ người dùng tích cực đó đang chia sẻ hàng tỷ các mẩu nội dung mỗi ngày, với hàng triệu khiếu nại của người dùng về nội dung Facebook được gửi mỗi ngày.

Facebook có vấn đề nghiêm trọng về an toàn người dùng không? Mới xuất bản Người giám hộ xem xét các tài liệu bí mật, nội bộ cho thấy vấn đề của nó nằm ngoài tầm kiểm soát.

Facebook thừa nhận rằng họ có một số vấn đề khi đầu năm nay, họ đã đồng ý tăng gần gấp đôi nhân viên đánh giá của mình - lên 7.500 - trong bối cảnh bị cáo buộc rằng công ty chỉ đơn giản là không làm (hoặc có thể quan tâm?) Đủ khi nội dung có hại tiềm ẩn được bán trên nền tảng của mình . Bạn sẽ không tăng gấp đôi nhân viên kiểm duyệt của mình nếu mọi thứ đều tồi tệ.

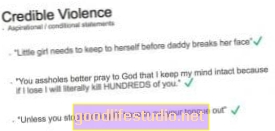

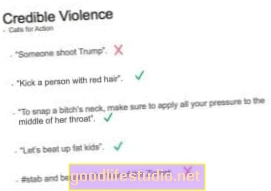

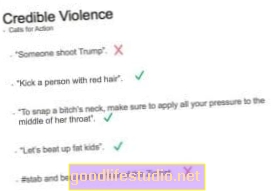

Hiện nay, Guardian (Anh) đã công bố chi tiết đáng kinh ngạc về các nguyên tắc kiểm duyệt nội dung của Facebook, được chọn lọc từ hơn 100 tài liệu và hướng dẫn đào tạo nội bộ, bí mật. Có một chút băn khoăn là tất cả những thứ quan trọng này không có trong một tài liệu hướng dẫn nào được cấp cho người kiểm duyệt của Facebook khi họ được thuê.Thay vào đó, nó dường như là một cách tiếp cận chính sách chắp vá, dẫn đến những thông tin dường như mâu thuẫn, kiểm duyệt không đồng đều và rất ít độ tin cậy về cách các chính sách kiểm duyệt của nó thực sự hoạt động trong thế giới thực.

Một nguồn tin cho biết: “Facebook không thể kiểm soát nội dung của mình. "Nó đã phát triển quá lớn, quá nhanh."

Nhiều người điều hành được cho là lo ngại về sự không nhất quán và tính chất đặc biệt của một số chính sách. Ví dụ, những nội dung về tình dục được cho là phức tạp và khó hiểu nhất.

Chỉ là một ví dụ nhỏ về mức độ kiểm duyệt nội dung của Facebook, các bài báo lưu ý, "Một tài liệu cho biết Facebook xem xét hơn 6,5 triệu báo cáo mỗi tuần liên quan đến các tài khoản giả mạo tiềm năng - được gọi là FNRP (giả mạo, không phải người thật)." Và đó chỉ dành cho các tài khoản giả mạo. Hãy tưởng tượng có bao nhiêu triệu báo cáo nữa dành cho nội dung thực tế.

Các tính năng trước khi nghĩ

Trước khi có bất kỳ suy nghĩ nào về cách mọi người có thể sử dụng (và lạm dụng) một tính năng mới, Facebook dường như ủng hộ việc giới thiệu nội dung và tìm cách kiểm duyệt nó như một suy nghĩ sau. Hãy xem Facebook Live, một dịch vụ phát trực tuyến video cho phép mọi người quay video bất cứ điều gì đang xảy ra trong cuộc sống của họ tại thời điểm này. Họ nghĩ mọi người cuối cùng sẽ sử dụng nó để làm gì?

Điều này cho thấy sự thiếu suy nghĩ nhất quán trong các vấn đề và chủ động giải quyết chúng trước khi chúng phát sinh. Hoặc sai ở khía cạnh, “Này, hãy cùng làm với điều này và xem nó nhận được phản ứng kịch liệt như thế nào trước khi chúng ta làm bất cứ điều gì về nó.” (Tất nhiên, tất cả đều nhân danh “tự do ngôn luận”, bỏ qua thực tế rằng Facebook là một nền tảng toàn cầu.) 1

Tôi đã Đặt lại Hướng dẫn Kiểm duyệt đó ở đâu?

Và có thể đặt tất cả chúng trong một hướng dẫn duy nhất? Vì vậy, người điều hành biết nơi để xem xét và có mọi hướng dẫn nhất quán?

Video tự làm hại bản thân hoàn toàn ổn trong thế giới của Facebook, vì người đó đang “gặp nạn”. Đối với động vật cũng vậy (có thể do con vật gặp nạn chăng?). “Nội dung khiêu dâm trả thù” cũng không sao, nếu người kiểm duyệt không thể xác nhận việc thiếu sự đồng ý của cả hai bên (theo tôi tưởng tượng, điều này có thể khá khó thực hiện kịp thời).

“Một số ảnh không lạm dụng tình dục và bắt nạt trẻ em không cần phải xóa hoặc“ xử lý ”trừ khi có yếu tố bạo dâm hoặc tán dương.” Miễn là bạn không để hình ảnh bạo lực và video ăn mừng ra khỏi hình ảnh và video bạo lực, thì có vẻ như Facebook sẽ cho phép chúng.

Theo các tài liệu, “Các video về những cái chết bạo lực rất đáng lo ngại nhưng có thể giúp nâng cao nhận thức. Đối với video, chúng tôi cho rằng trẻ vị thành niên cần được bảo vệ và người lớn cần được lựa chọn. Chúng tôi đánh dấu là video 'đáng lo ngại' về cái chết bạo lực của con người. " Không rõ nội dung tự sát - chẳng hạn như video trực tiếp hoặc lời đe dọa - nằm trong chính sách kiểm duyệt của Facebook, nhưng nó có vẻ được cho phép.

Facebook Cần Ưu tiên An toàn Người dùng

Một số người đã kêu gọi Facebook phải được quản lý chặt chẽ hơn, vì nó là người gác cổng của tất cả nội dung này (giống như một đài truyền hình là người canh giữ nội dung trên mạng của nó):

Một báo cáo của các nghị sĩ Anh được công bố vào ngày 1/5 cho biết "các công ty truyền thông xã hội lớn nhất và giàu có nhất còn lâu mới thực hiện đủ hành động để giải quyết nội dung bất hợp pháp hoặc nguy hiểm, thực hiện các tiêu chuẩn cộng đồng phù hợp hoặc giữ an toàn cho người dùng của họ".

Lỗi ở khía cạnh “tự do ngôn luận” có vẻ là một ý kiến hay, đặc biệt là đối với một công ty Mỹ. Nhưng mạng xã hội chủ yếu là cộng đồng trực tuyến - chúng không giống như báo chí. Mục đích chính của Facebook là kết nối mọi người với nhau. Theo đó, các hướng dẫn của họ sẽ phản ánh nhiều hơn sự đa dạng này và được thiết kế vì sự an toàn của cộng đồng đó, thay vì một số loại thần chú xuất bản tin tức hoặc hệ tư tưởng trống rỗng.

Chúng tôi muốn thấy Facebook minh bạch hơn về cách thức kiểm duyệt hàng triệu người và nội dung mỗi ngày. Việc làm sáng tỏ hơn những vấn đề này sẽ giúp chỉ ra các vấn đề và mang đến cho Facebook cơ hội để cải thiện sự an toàn của cộng đồng. Và chúng tôi muốn thấy Facebook kiếm được nhiều thu nhập hơn vào việc đảm bảo có đủ nhân viên để giữ cho nền tảng của mình an toàn. Cho tất cả người dùng.

Để biết thêm thông tin

Chú thích:

- Ồ, và lưu ý rằng nếu bạn có thêm 100.000 người theo dõi trên Facebook, thì trong mắt họ, điều đó khiến bạn trở thành “người của công chúng” - và không phải tuân theo quyền riêng tư hoặc các biện pháp bảo vệ khác của người bình thường. [↩]